SFの題材として頻繁に取り上げられ、科学への関心の入り口として存在感を増してきた「ロボット」。近年内閣府が提唱するSociety 5.0においても、ロボットや人工知能が中心的な技術の一つとして大いに注目されている。今回より、ロボットが歩んできた歴史や現在ロボット研究に携わる専門家の意見を交えつつ、これからのロボットの在り方を連載の形で探っていきたい。第1回では「ロボット工学三原則」という概念から、ロボットと人間の倫理を考える。

(取材・村松光太朗)

SF小説発祥の倫理

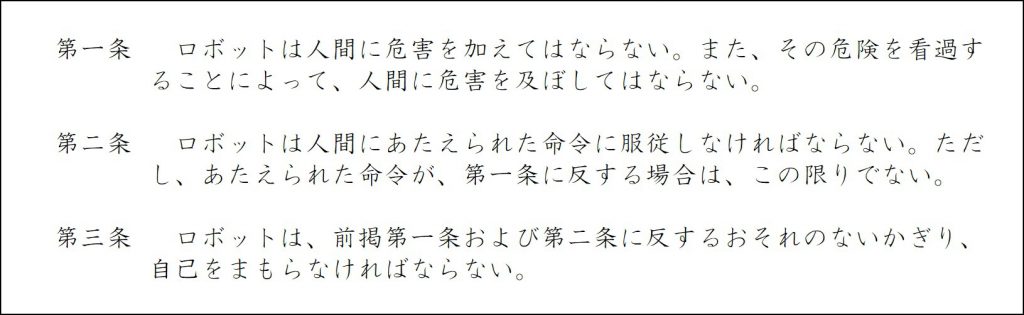

ロボットに関する議論で話題になることの一つに「ロボット工学三原則(以下、三原則)」(図1)がある。米国のSF作家であるアイザック・アシモフが、ロボットシリーズという一連の著作においてその概念を示し、同作品群のミステリー要素として確立させたものだ。

『われはロボット〔決定版〕』(早川書房)より引用

作中のロボットにはこの三原則を担う「陽電子頭脳」が埋め込まれており、ロボットたちが引き起こす不可解な事態を主人公の科学者らが三原則に照らし合わせながら解決していく。なお、ロボットシリーズの代表作『われはロボット(原題:I, ROBOT)』は本連載企画『WHO, ROBOT』の名前のもととなっている。

『われはロボット〔決定版〕』

原題『I, ROBOT』アイザック・アシモフ著、小尾芙佐訳、早川書房、税込み924円

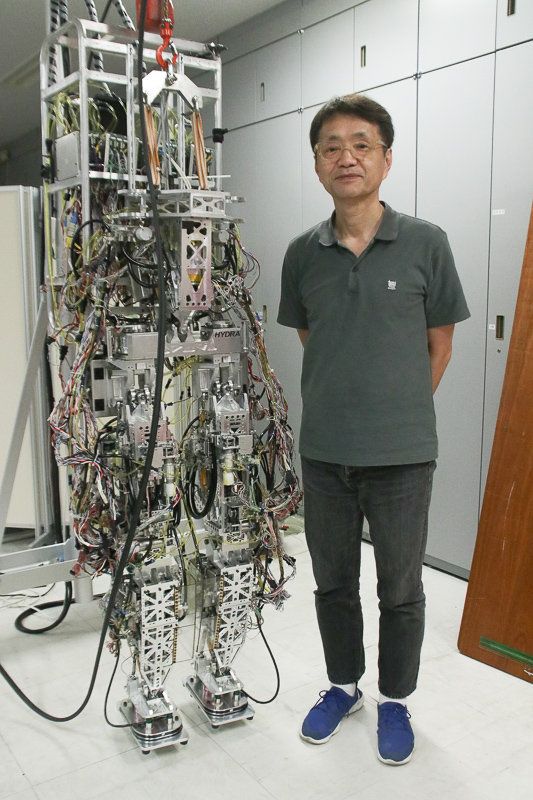

この三原則は、現実のロボット工学研究においても倫理としての影響を持つと言われている。現場で実際に研究開発を進める中村仁彦教授(情報理工学系研究科)にその真相を聞くとともに、SFでしばしば描かれるロボットの自我や意識と三原則との衝突可能性についても尋ねた。

三原則はどのような倫理なのか?「研究倫理」とも関係があるのか?

「研究倫理」と三原則は無関係です。「研究上必要な実験や調査において守られるべき指針」というのが文字通りの研究倫理であり、例えばデータの公正さや被験者の自律性、個人情報の管理などが考えられます。これはロボット工学に限らず全ての分野で守られるべきものです。

三原則が倫理としての意味合いを持つのは、ロボットが実社会で人間と接する状況があるからです。しかし、研究で普段から三原則を意識することはありません。なぜなら、三原則は極めて当たり前なことだからです。

三原則は人間の倫理?

三原則という名前こそありますが、その正体は人間の倫理です。自分の命は大切にすべきだとか、他人を傷付けてはならないとかいった人間の基本的な規範を、単純化してロボットに当てはめたものに過ぎません。ロボットや人工知能の研究において倫理は重要なテーマですが、実際の人間の倫理はより複雑なものであることを踏まえると、三原則が最重要課題や最終目標として捉えられることはないでしょう。ロボットの倫理そのものに注力する研究者もいますが、ロボット研究の中ではサブテーマの一つです。

ロボットの自我や意識は三原則と衝突するか?

アシモフの作品ではまさにその様子が描かれていますが、そもそも人工知能やそれを搭載したロボットに自我が芽生えるのかどうかは現時点では断定しかねます。仮に芽生えた場合にそれが人工知能に刻まれた三原則と板挟みになるのかも分かりません。ただ、仮に三原則あるいは倫理に基づいて動くはずのロボットが人から見て、あるいは人工知能から見て一見倫理に反するような行動を取った場合には、どのような処理を経てその判断に至ったかをロボット自らが説明できることが重要です。この判断が人道的かどうかが倫理の問いだからです。ロボットの頭脳となる人工知能ですが、現状では情報の入力に対して結論を出すだけで、その過程がほとんど分かりません。しかしこれでは問題が発生したときに改善を図りづらいことから、近年では情報処理の過程を「説明可能な人工知能(XAI)」の必要性が高まっており、研究開発が進んでいます。人工知能やロボットの自我、意識に関わる議論は、恐らくこうした研究の先に芽生えてくるものでしょう。

法律家ロボット登場はまだ先?

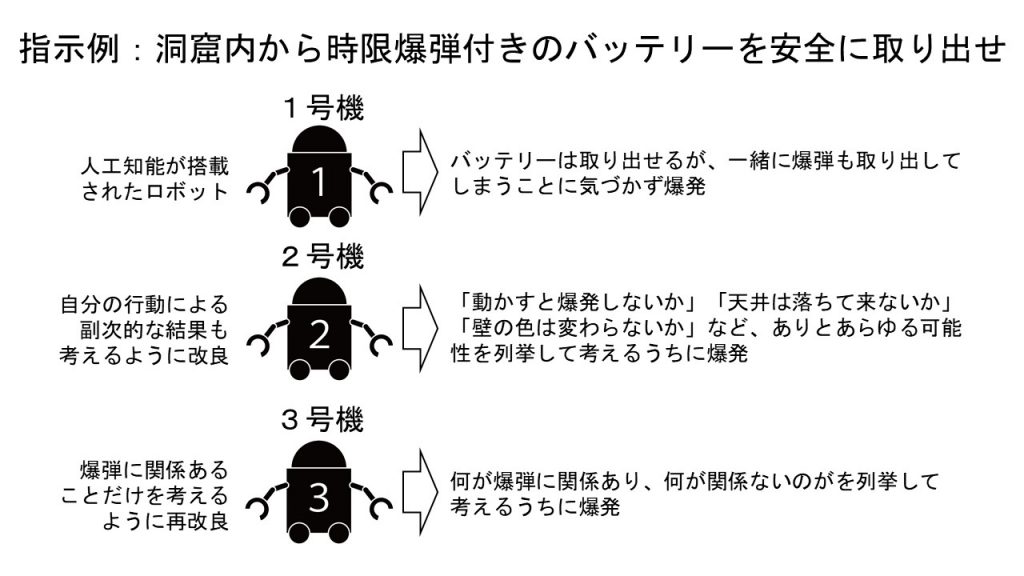

現実の機械の情報処理能力は有限であるため、自律型のロボットの頭脳となる人工知能の実現には「フレーム問題」(図2)という難問が付きまとう。この問題は三原則とどう絡み、また人工知能やロボットと人間との関係をどう決めていくのだろうか。再び中村教授に尋ねた。

フレーム問題の根源は?

この世界に存在する概念を一つ一つ言語化してフレームという枠組みにはめ、それらを集めれば世界を記述できるのではという考えが現れ、実際にプログラミング言語を用いてその試みがなされたことがあります。しかし、うまく行きませんでした。そこで認識されるようになったのがフレーム問題です。

何かを言語化するということは、何らかの情報を圧縮し、抽象化によって再利用できる形に落とし込むことです。そのため、ある種の情報は抜け落ちてしまいます。人間は「そこの消しゴム取って」という曖昧な命令でも遂行できますが、人工知能からすれば「そことはどこか」という点だけでも無数の可能性があります。抜け落ちた文脈や環境などの情報を補うことが必要です。

単純な三原則ではフレーム問題に太刀打ちできないのか?

人間の行動基準の指針とも捉えられる倫理ですが、これも基本的には言語で表されます。そして三原則は先述の通り、基本倫理としてあまりにも単純です。これだけでは、やはりフレーム問題からは逃れられないでしょう。

倫理の研究者から「犯罪の事実だけを記述したものから、刑や罰を決めることはできない」と聞き、フレーム問題との共通性に気付きました。実際には事件の背景にどんな事情があり、どんな感情が起き、どんな文化性が潜んでいるのかを人道に照らして、倫理的な結論を出すのが法律家の仕事であるとのことでした。人工知能にとってはかなり対応の難しい分野ですし、このような判断を可能とするロボットが現れる日はそう早くは来ないでしょう。

人工知能の社会介入に対して人間側は何をすべきか?

将来的に人工知能がこのような問題を自在に処理できるようになるかは技術革新次第ですが、可能性は高いと思います。むしろより考えるべきは、人工知能やロボットが人間社会にどこまで介入でき、どこから介入してはいけないかという線引きを社会が始めることだと思います。人工知能は定量的な判断に長け、ロボットは厳しい環境に耐性があるので、例えば宇宙開発には活用するが、先に述べたような本当に重要な倫理的判断には必ず人間が関わるべきです。

82年京都大学大学院博士課程修了。工学博士。京都大学助手、カリフォルニア大学サンタバーバラ校準教授などを経て01年より現職。写真左は研究室で開発した人型ロボット・Hydra。

【連載:WHO, ROBOT】

- ロボットと人の役割分担明確に ~東大教授と迫る「ロボット工学三原則」~ <- 本記事

- ロボットのコミュニケーションとビジネス戦略に迫る

- ロボット通じ学生の挑戦促す「ヒト型ロボット」研究開発の意義とは

- 新しい身体が広げる可能性~テレイグジスタンスって?~

- 遠隔化の波は診療を超えて手術まで~ロボット工学と医学の融合~

この記事は2019年10月22日号から転載したものです。本紙では他にもオリジナルの記事を公開しています。

ニュース:変わる高校入試 中学で教育さらに高度化 中高一貫校の高校募集停止の背景

ニュース:リーグ最下位確定 硬式野球立大戦 打線振るわず連敗

ニュース:細胞のインフルへの防御機構解明

ニュース:量子コンピューター大規模化 実現へ加速

ニュース:台風19号 駒場・本郷ともに閉鎖措置

ニュース:AI技術でSNSのハッシュタグを改善

ニュース:極薄炭素層の準結晶 高速で巨大電場生成

ニュース:遠赤色光が光合成促進

ニュース:学生向けスペース「知るカフェ」駒場にも

企画:WHO,ROBOT ロボットと人の役割分担明確に 「ロボット工学三原則」に迫る

企画:音を立てるのは日本文化? 麺の食べ方巡る対立

東大新聞オンラインPICK UP:スポーツ編

東大教員と考える日本の問題:「日本社会と外国人」石田賢示准教授(社会科学研究所)

地域の顔 本郷編:わだつみのこえ記念館

キャンパスガール:戸倉佳音さん(理Ⅱ・1年)

※新聞の購読については、こちらのページへどうぞ